L’alerte est arrivée par courriel sur la boîte de Mediapart. Un blogueur attirait l’attention sur l'un de ses billets. Habituel. Mais comme il s’agissait de Jean-Paul Baquiast, dont on suit le combat pour la modernisation de l’Etat par Internet sur Admiroutes depuis une quinzaine d’années, on y prête un peu plus d’attention.

Le texte est long, touffu, ambigu parfois, mais porte sur des sujets qui nous intéressent d’ordinaire: « Les réseaux sociaux, les fichiers de surveillance, les Anonymous... des systèmes évoluant vers l’autonomie ». Il est signé « Alain Cardon, professeur des universités », spécialiste de l'intelligence artificielle, ancien du laboratoire d’informatique de Paris-6, directeur de celui de l'université du Havre jusqu’en 2003.

On rencontre donc (avec Michel de Pracontal) Alain Cardon et Jean-Paul Baquiast pour en savoir plus.

La conversation est stimulante : au-delà de l'intelligence artificielle, développée pour résoudre des problèmes posés et contrôlés par l'homme, une branche de l'informatique s'intéresse à la possibilité de doter des systèmes d'information d'une autonomie de décision, voire d'une initiative. Dans un ensemble distribué en réseau, ces “consciences artificielles” peuvent interagir entre elles, évoluant potentiellement vers une forme sociale.

Le lexique pose problème, car il transpose à la machine des catégories adaptées du vivant, mais du point de vue des effets, sinon de la nature, le rapprochement se comprend.

Cette nouvelle couche “consciente”, explique Alain Cardon, se caractérise par la capacité de la machine à définir ses propres objectifs en fonction de besoins primaires – agir, communiquer, ... – prolongés par de l’“affectivité” : de son support matériel (capteurs...), de sa “ corporéité”, elle tire une évaluation des conséquences de ses décisions en fonction de représentations pour elle-même qu'on peut rapprocher du plaisir ou de la douleur.

« Il y a plusieurs objectifs possibles, poursuit Alain Cardon, il va falloir en choisir un et c’est pour ça qu’il faut des envies » dont la satisfaction est évaluée par et pour le système et constitue une expérience acquise. Dès lors, on postule une forme de conscience qui lui permettrait de s’adapter à des situations inédites et d'en tirer ses propres normes.

Cela pose plusieurs questions :

- l'anthropomorphisme. Quelles sont les limites de l'analogie avec le psychisme humain ? L'idée de conscience qui surplombe l'intelligence est certes féconde pour concevoir des routines qui miment les processus d'apprentissage et de décision humains, tout en les faisant bénéficier de la vitesse et la puissance de calcul des machines ainsi que de l'ubiquité de l'informatique distribuée. La crainte, exploitée par la science-fiction, consiste à anticiper l'apparition d'un troisième terme de cette autonomie qui relèverait des pulsions (voir par exemple La Chute d'Hypérion de Dan Simmons, avec le projet d'“Intelligence ultime”). Mais ces pulsions, humaines par nature, sont-elles nécessaires à l'accomplissement de la conscience?

- le numérisme. Le monde appréhendé par les capteurs, nécessairement mesurable, quantifiable, est réduit à sa dimension chiffrée, mais celle-ci rend-elle compte exhaustivement du réel ? Ne manque-t-il pas dans cette perception nombre de dimensions indénombrables qui échappent à la mesure et donc à la compréhension de la réalité par les machines ?

- l'acceptabilité. Pouvons-nous (psychologiquement, moralement, socialement) accepter que la décision finale échappe à un responsable humain ? L'expérience montre que la réponse est plutôt négative, mais inversement le souci d'efficacité, la complexité, la rapidité, l'interdépendance d'un nombre croissant de systèmes de gestion ne conduisent-ils pas déjà à faire ratifier après coup des actes déjà exécutés par des programmes d'« aide à la décision » ?

- l'innocuité. Pouvons-nous garantir que les règles et les connaissances implémentées débouchent sur des résultats qui ne nuisent à personne ? C'était la condition posée par l'auteur de science-fiction Isaac Asimov dans la première de ses trois lois de la robotique: « Un robot ne peut porter atteinte à un être humain, ni, restant passif, permettre qu'un être humain soit exposé au danger » (voir Toward Safe Robots de Sami Haddadin).

Alain Cardon et Jean-Paul Baquiast appellent au lancement d'un grand débat sur ces questions, voire à la création d'un comité d'éthique spécifique, « ouvert et critique », permettant la rencontre des scientifiques, des politiques et des citoyens.

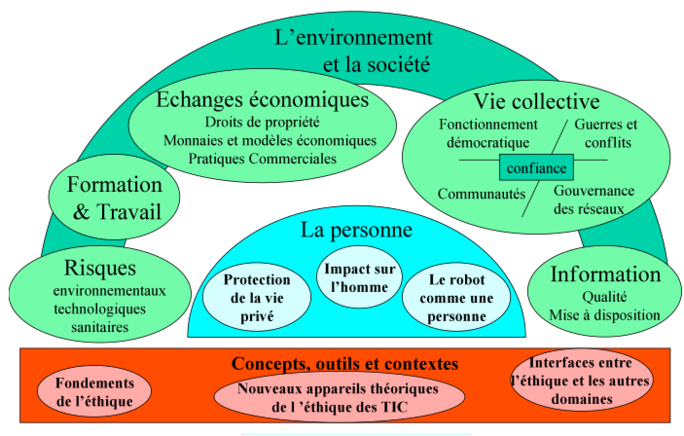

Agrandissement : Illustration 4

Le comité d'éthique du CNRS (Comets) a abordé ces questions en 2009 dans le rapport « Pour une éthique de la recherche en sciences et technologies de l'information et de la communication »: « l’arrivée des robots modifie la relation de l’humain au monde physique et nécessite une réflexion éthique pour accompagner le développement scientifique et technologique. Les recherches se situent à l’interface de l’informatique, de l’automatique, du traitement du signal et des images, de la communication homme-machine, de l’intelligence artificielle, de l’aide à la décision, de l’électronique, de l’énergétique, de la mécanique ..., les robots étant dotés de fonctions de perception, décision, action, mouvement, apprentissage et communication » et l'INRIA avait publié ses recommandations plus générales pour la création d'un comité d'éthique.

La Commission nationale de l'informatique et des libertés vient également d'annoncer la création d'un comité de la prospective en son sein qui devrait commencer à travailler à la rentrée de septembre. La CNIL entend ainsi développer « un espace d'échanges et de réflexion sur les problématiques Informatique et libertés », « favoriser le débat public sur les enjeux Informatique et libertés », « identifier, comprendre et anticiper les transformations technologiques présentes et à venir et en évaluer les enjeux éthiques ».

- Lire aussi le texte d'Alain Cardon et Jean-Paul Baquiast, rédigé après notre rencontre: « Sciences, technologies et politique. Nouvelles technologies numériques et combat pour la démocratie »