Agrandissement : Illustration 1

Les médias synthétiques inquiètent depuis trois ans le milieu de la politique. Aux États-Unis, quelques mois après la parution du premier article sur les deepfakes 2 c’est une vidéo où l’acteur américain Jordan Peele manipule une marionnette numérique de Barack Obama 3 qui met le feu aux poudres. Les deepfakes, jusqu’alors cantonnés à la sphère du porno amateur et du mashup 4 vidéo, montrent leur potentiel et attirent l’attention des observateurs de la vie politique usés par 4 ans de présidence Trump. Le scénario catastrophe prend forme sous leurs yeux. Le récit fondateur des deepfakes s’architecture autour de cette hypothétique nouvelle menace contre la démocratie. Le contexte Trumpien aux États-Unis participe de cette montée en force du discours dans les sphères du pouvoir (médiatique et politique), après tout, la dystopie que certains démocrates redoutaient déroule tout son plan en plein jour.

Agrandissement : Illustration 2

En quelques jours donc, la vidéo qui a fait le tour du web et continue de marquer les esprits chez l’oncle Sam comme à l’étranger. Elle reste à ce jour, la plus citée dans les articles concernant l’influence des deepfakes sur la politique (la seconde place revenant probablement au shallow-fake de Nancy Pelosi). C’est elle que cite Olivia Grégoire dans son interview, c’est cette vidéo qui semble avoir déclenché la réflexion de la secrétaire d’État. Or, pas de chance, le temps a fait son œuvre et nous savons aujourd’hui que les craintes d’hier auront du mal à se concrétiser. Pourquoi ?

La technologie n’est pas suffisamment mature

Contrairement aux affirmations d’Olivia Grégoire, il est trop tôt pour avoir peur des deepfakes. Si les médias synthétiques posent un certain nombre de questions éthiques, philosophiques ou pratiques qu’il faudra tôt ou tard régler, ils ne constituent pas un outil de manipulation crédible capable de déstabiliser les démocraties.

Premier écueil, la technologie n’est pas encore suffisamment mature. Il n’est à ce jour pas possible de générer des deepfakes convainquant en un clic de souris magique. Les deepfakes les plus sophistiqués, ceux qui ont légitimement provoqué le doute chez les lecteurs, ont nécessité le travail d’un remarquable acteur puis qu’on entraine un GAN 5 pendant des mois et qu’enfin qu’on retouche à la main des segments vidéo entiers pour masquer au mieux les coutures de la greffe numérique opérée 6.

L’audio reste le principal écueil sur lequel le réalisme échoue. Si les progrès dans la reconstitution synthétique de voix sont assez spectaculaires 7, l’oreille humaine détecte encore les imperfections, les différences de ton, de pitch et de rythme des voix synthétiques renforçant ce sentiment étrange qu’on est en présence d’un faux 8.

Le mieux étant l’ennemi du bien, on objectera qu’il suffit de diffuser des contenus manipulés grossièrement pour faire le boulot et tromper des centaines de milliers d’électeurs. Là encore, la déclaration d’Olivia Grégoire contraste avec la réalité. Autre vidéo à avoir largement circulé et galvanisé les peurs les plus fortes au sujet de la manipulation politique, le shallow fake de Nancy Pelosi (cité également par l’interviewée) 9, n’était en réalité qu’une vidéo ralentie. On quitte ici le domaine du deepfake pour revenir dans un domaine de manipulation bien plus traditionnel, réalisée à l’aide de logiciels grand public. Nul besoin d’invoquer les réseaux de neurones, l’intelligence artificielle ou les médias synthétiques. L’intelligence humaine et l’huile de coude suffisent à fabriquer ces boucles vidéo de quelques secondes. Reste à savoir quel est leur impact.

La caisse de résonance

Dans ce récit en développement, il faut faire un aparté et noter que le traitement par la presse de la question des deepfakes ne rend pas justice à la complexité du sujet. Il repose généralement sur quatre angles principaux : la création d’un deepfake est à la portée de tous 10, les deepfakes trompent le public et minent le socle commun qu’est la réalité, les potentielles manipulations politiques grâce aux deepfakes mettent en danger la démocratie et — de façon moins prégnante — les deepfakes permettent de créer des vidéos pornographiques non consenties (ce qu’on appelle du revenge porn par exemple). 11. À cela, on peut ajouter une sous-catégorie, plus technique, consacrée à la détection des deepfakes et aux méthodes, aux trucs et astuces pour identifier un média synthétique.

Ce type de traitement entraine de facto une simplification du contexte d’apparition des deepfakes, caricature les motivations des créateurs, exagère les dangers réels ou supposés et finit par véhiculer un point de vue relativement anxiogène par rapport à la réalité de la menace 12. En cela, l’interview d’Olivia Grégoire n’aide pas à analyser posément les questions que soulèvent les deepfakes.

En observant les publications depuis 2018, on observe que des phases nettes peuvent être observées dans le traitement thématique. Ce sont les deep-porns impliquant des célébrités qui ont permis d’attirer l’attention du grand public sur le phénomène. Puis la perspective des élections américaines a soulevé une première vague de questionnements sur les enjeux démocratiques (c’est là qu’apparaît la vidéo de Jordan Peele). La publication d’un rapport sur l’inflation des deep-porns a ramené le débat sur la question des femmes victimes de ces vidéos (cette fois-ci avec un focus plus important sur les femmes qui ne sont pas des célébrités). Puis l’attention s’est de nouveau porté sur les enjeux sécuritaires (bien souvent dans un cadre politique, mais de plus en plus également dans un cadre économique) avec l’apparition de différentes affaires d’espionnage 13.

Pour chacune de ces vagues, la question des contre-mesures, de la prévention, de la détection et des dispositions législatives s’est posée. Le récit médiatique construit autour de la diffusion des médias synthétiques dans l’espace culturel numérique n’a que très rarement exploré les raisons mêmes de l’existence des deepfakes : quelles technologies permettent ces manipulations, quelles entreprises sont derrière ces technologies, quel phénomène permet la multiplication de contenus pornographiques sur le web, quel est le marché de la pornographie en ligne, la publicité politique est-elle souhaitable, etc., etc. Il n’a pas non plus exploré les questions éthiques que soulève le solutionnisme technique avancé pour réguler l’existence des deepfakes : traçage digital des contenus créés (via blockchain ou NFTs ?), de leur diffusion, de leur consommation, restrictions sur les types de contenus numériques qu’on peut créer, restriction temporelle de diffusion de ces contenus, toutes sont attentatoires aux libertés individuelles et à la liberté d’expression et artistiques. Le mieux serait au moins d’initier le débat.

Un impact relatif ?

Fabriquer et diffuser des contenus manipulés suffit-il pour manipuler les foules ? Des électeurs peuvent-ils modifier leur vote après avoir découvert un deepfake politique ? Un certain nombre de recherches montrent les effets des médias synthétiques sur la psyché humaine et questionne précisément leur impact sur les décisions politiques. Ces études, encore relativement éparses, suggèrent bien un impact à long terme sur l’individu, mais très limité et pas de nature à bouleverser un scrutin.

Une première étude concernant les comportements politiques 14, indique par exemple que dans certains cas spéficiques de microtargeting les deepfakes peuvent influencer la façon dont on perçoit les hommes politiques victime de deepfakes, voire les partis auxquels ils appartiennent. Une autre étude menée en Grande-Bretagne montre que les deepfakes développent chez les spectateurs une sorte de méfiance cynique vis-à-vis des contenus d’information en ligne alors qu’on attendait une certaine crédulité 15.

À ces résultats modestes, il faut ajouter que les deepfakes produits ne constituent qu’une goutte d’eau dans l’océan de contenus qui sont créés chaque jour sur internet. Quand le dernier rapport de Sensity pointe une explosion exponentielle du nombre de deepfakes portant leur nombre à plus de 90 000, il faut réaliser que 90 % d’entre eux sont des deep-porns, que parmi les 10 % qui restent se trouvent beaucoup de deepfakes expérimentaux, de deepfakes réalisés par des amateurs et que seul 1 % de ces vidéos synthétiques sont des créations ultra-réalistes capables d’éventuellement challenger le sens critique de tout à chacun.

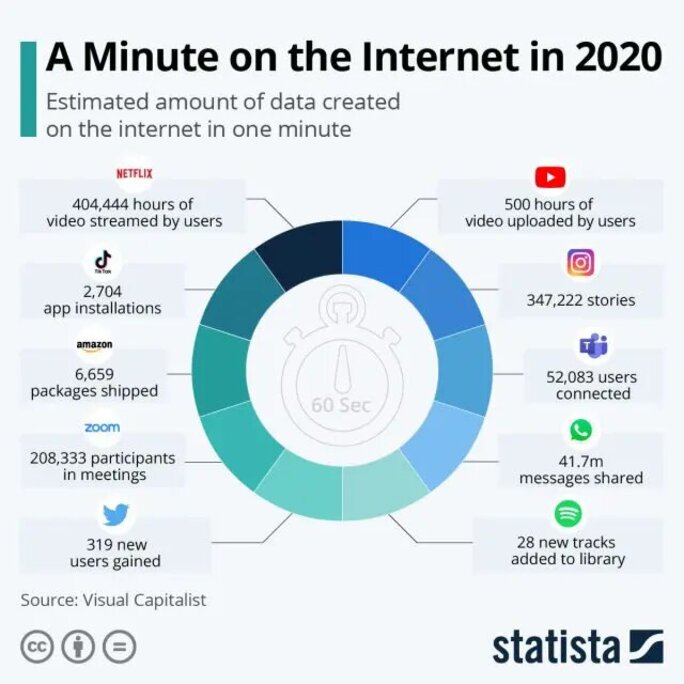

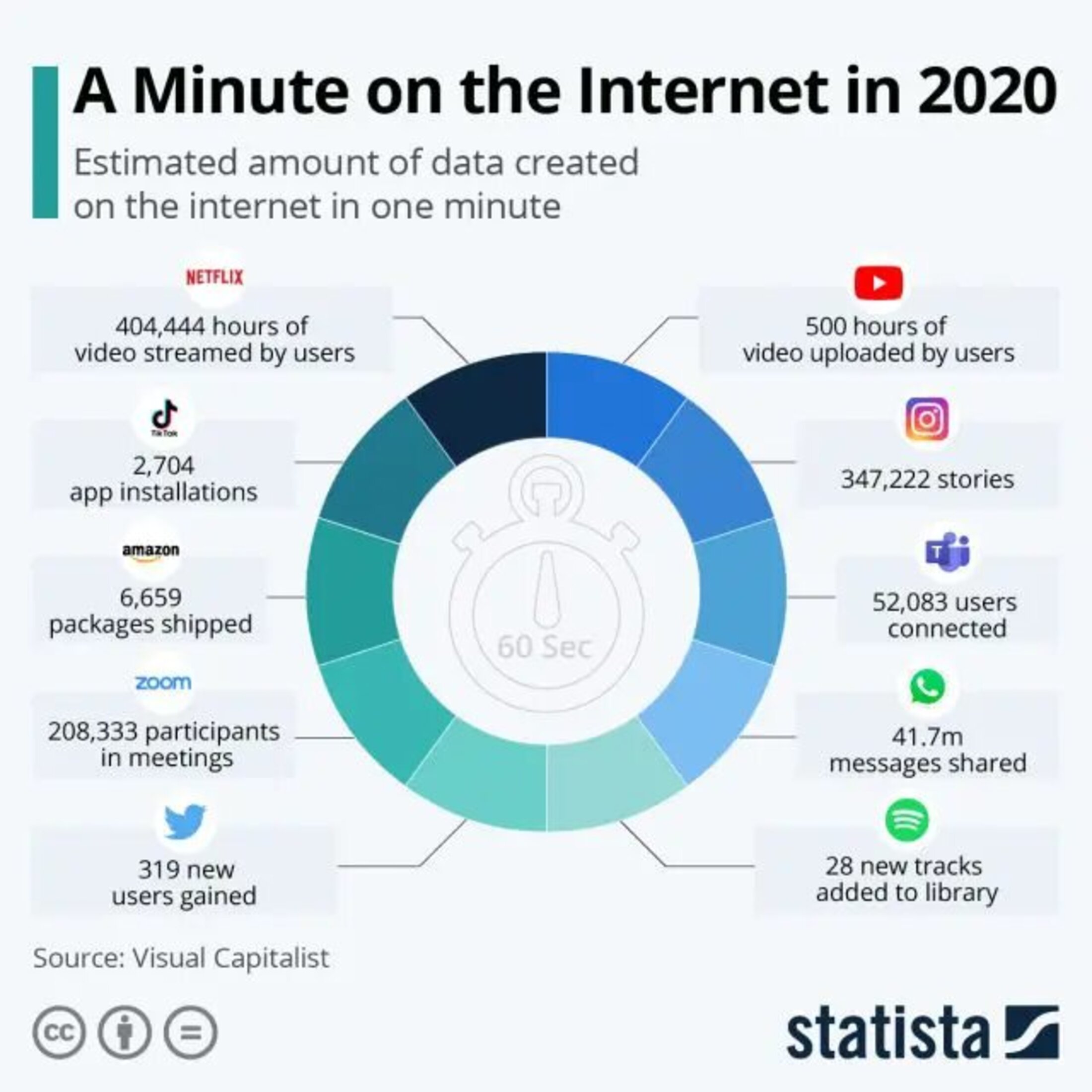

Agrandissement : Illustration 4

Il faut également rappeler que chaque minute, ce sont 500 heures de contenus vidéo qui sont téléversés sur YouTube. Sur Instagram, 95 millions de photos et vidéos sont partagés quotidiennement. Chaque jour, l’humanité produit 2,5 quintillions bits de données 16. C’est dans cet univers déjà fortement encombré, où l’attention des internautes devient un enjeu stratégique, où les sollicitations proviennent de plus en plus de nos environnements physiques (avec les objets connectés) et sociaux numériques, où les médias traditionnels continuent de jouer un rôle relativement important, c’est donc dans ce système qu’éclosent les deepfakes.

L’influence des deepfakes semble donc encore toute relative et les affirmations à l’emporte-pièce prédisant la fin de la démocratie sont à prendre avec beaucoup de précautions. Nul doute que certains acteurs tenteront d’exploiter le potentiel des médias synthétiques pour perturber à leur avantage l’équilibre précaire dans lequel se trouvent nos démocraties. Certains pourront même engranger quelques mineurs succès dans les prochaines années, mais il ne faut pas s’attendre à une révolution immédiate.

Alors ? Pas de problème ?

Il faut comprendre que les deepfakes sont parmi nous et qu’ils ne s’en iront plus. Progressivement, les médias synthétiques vont percoler des franges à peine fréquentables d’internet à des secteurs d’activité plus grand public. Déjà les studios à Hollywood explorent leur potentiel dans les créations cinématographiques. On entrevoit d’autres possibilités, dans l’information, la traduction, les véhicules autonomes, la médecine.

Un certain nombre de pays à travers le monde ont adopté une nouvelle législation concernant l’usage des deepfakes 17. Certaines d’entre elles portent sur la publication de vidéos manipulées dans un contexte électoral et définissent des périodes d’interdiction. D’autres portent sur la question de la pornographie et de la protection de victimes de revenges-porns. Le législateur réagit à une urgence qui n’existe pas et oublie de penser l’avenir de ces technologies pour l’instant inévitables. Car discuter de ces technologies (et ce n’est pas réservé aux médias synthétiques) c’est aussi se poser la question de leur utilité, de leur nécessaire existence dans la sphère publique ou de leur vacuité. On pourrait tout à fait interdire les deepfakes. Un pays, par l’intermédiaire de son corps législatif, pourrait tout à fait considérer que les médias synthétiques posent plus de problèmes qu’ils n’apportent de solution et les bannir tout entier. Ce choix est politique, il ne relève pas de la simple fatalité.

Pour terminer. L’arsenal juridique en France couvre largement l’ensemble des préjudices qui peuvent être causés par un usage malintentionné de vidéos synthétiques. La diffamation, l’usurpation d’identité, le droit à l’image et même l’outrage à une personne dépositaire de la puissance publique peuvent s’appliquer pour une majorité de cas. Le défi ne réside pas dans la qualification d’une infraction éventuelle. Le défi consiste à retrouver l’auteur du deepfake qui a porté préjudice. En cela, la situation ne diffère pas des cas d’escroquerie, de trafic d’images pédopornographique ou d’autres délits du même acabit. Il faut des moyens pour remonter jusqu’aux auteurs et démanteler les réseaux. Moyens que seul un gouvernement peut attribuer. Olivia Grégoire accorderait-elle des moyens conséquents pour avancer sur sujets ?

Cet article a été publié pour la première fois sur deepfake.media

Références

1. « Olivia Grégoire : “On n’échappera pas aux deepfakes en 2022”, L’Express, le 10 avril 2021

2. « AI-Assisted Fake Porn Is Here and We’re All Fucked », Motherboard, Vice, Cole Samantha, 11 décembre 2017

3. You Won’t Believe What Obama Says in This Video!, Buzzfeed Video, Peele Jordan, le 17 avril 2018

4. pour rappel, « le mashup relève avant tout d’un état d’esprit. Intimement lié à la nature même d’internet, à son histoire, ses usages, c’est un pilier du web participatif. Il hérite toutefois d’une pratique de collage bien plus ancienne, issue de l’avant-garde cinématographique et du Found Footage. Il s’agit donc d’une expression artistique convoquant le recyclage, le remploi de matériaux audiovisuels produits par d’autres. » Wikipedia

5. un réseau de neurones artificiels, un algorithme en somme, impliqué dans la conception de deepfakes

6. « Chris Umé : le deepfake @deeptomcruise est fait pour alerter le public », le 5 mars 2021

7. « [AI Voice] Dating Tips from Kylo Ren » – voix synthétique de l’acteur américain Adam Driver, Speaking of AI, le 14 février 2021

8. c’est ce qu’on appelle, la notion de « vallée de l’étrange » (Uncanny Valley), inventée dans les années 1970 par le roboticien Masahiro Mori, désigne le fait que, lorsqu’un objet atteint un certain degré de ressemblance anthropomorphique apparaît une sensation d’angoisse et de malaise. « Petit détour par la vallée de l’étrange », CNRS le journal, le 16 février 2016

9. « Real v fake: debunking the ‘drunk’ Nancy Pelosi footage—video », The Guardian, le 24 mai 2019

10. la réalité est plus subtile, il ne faut certes plus une armée de créateurs d’effets spéciaux pour faire un deepfake, mais la tâche demande encore beaucoup de connaissances, de techniques et un équipement solide

11. Chandell Gosse & Jacquelyn Burkell (2020) Politics and porn: how news media characterizes problems presented by deepfakes, Critical Studies in Media Communication, 37:5, 497–511, DOI: 10.1080/15295036.2020.1832697

12. depuis février 2018, j’ai pu constituer un corpus bibliographique regroupant 680 entrées, articles, études, rapports décrivant le phénomène des deepfakes, très peu abordent par exemple des aspects positifs liés avec le développement des médias synthétiques.

13. « Oliver Taylor, étudiant modèle et pure fiction », le 28 juillet 2020

14. Dobber, Tom, Nadia Metoui, Damian Trilling, Natali Helberger, and Claes de Vreese. “Do (Microtargeted) Deepfakes Have Real Effects on Political Attitudes?” The International Journal of Press/Politics 26, no. 1 (January 2021): 69—91. https://doi.org/10.1177/1940161220944364.

15. Vaccari, Cristian, and Andrew Chadwick. “Deepfakes and Disinformation: Exploring the Impact of Synthetic Political Video on Deception, Uncertainty, and Trust in News.” Social Media + Society (January 2020). https://doi.org/10.1177/2056305120903408.

16. « How Much Data Is Created Every Day in 2020? », le 18 mars 2021

17. en Allemagne, les deepfakes tombent sous le coup du droit commun. Aux États-Unis, certains états ont passé une législation spécifique comme la Californie ou le Texas. La proposition de loi S. 3805 a été déposée au Sénat le 21 décembre 2018 pour réguler les deepfakes au niveau fédéral. D’autres pays comme la Nouvelle-Zélande, la Corée ou l’Angleterre ont adopté des textes ou fait des propositions de loi en ce sens également.