Agrandissement : Illustration 1

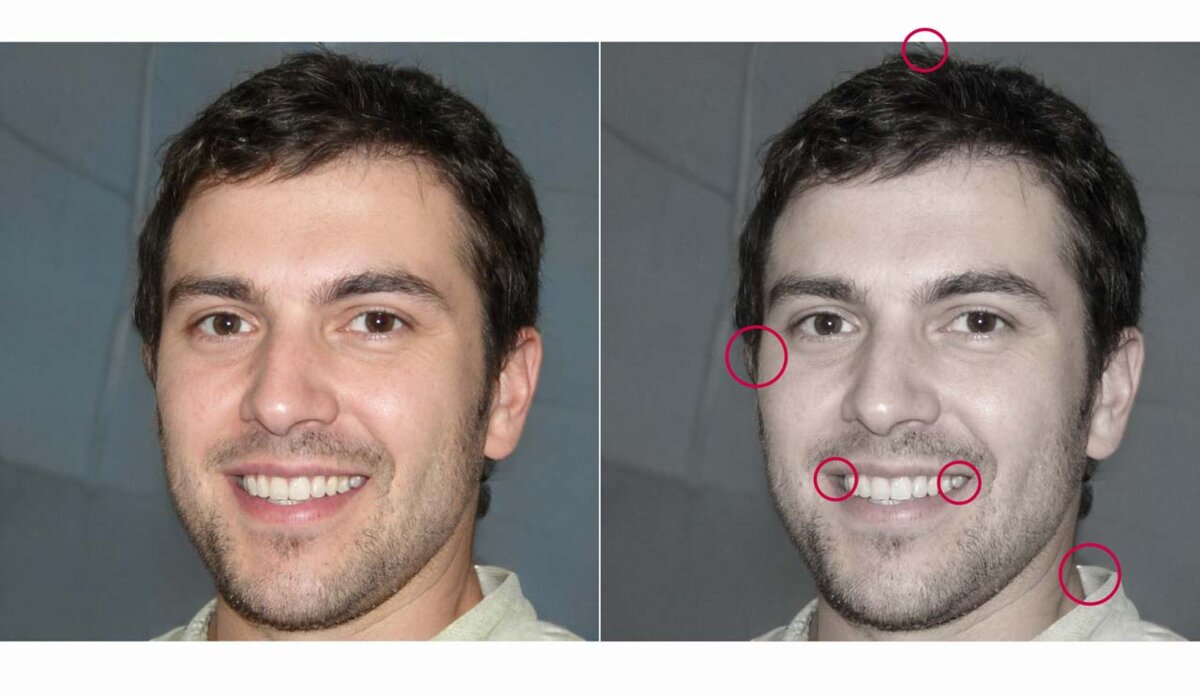

Le garçon ne paie pas de mine. Son visage juvénile de gendre parfait, barré d’un large sourire, ressemble à ceux qu’on trouve dans toutes les bonnes facultés du Royaume-Uni. Pourtant Oliver Taylor est au cœur d’une affaire étrange, impliquant plusieurs journaux israéliens et l’université de Birmingham. C’est l’agence Reuters qui donne l’alerte au début de l’été (1). Dans un article rapide, Raphael Satter

nous livre une petite enquête tout à fait intéressante où il dévoile que Taylor est une fiction. Un profil fantôme, destiné à approcher une cible puis à actionner un plan prédéfini.

À l’instar de Maisy Kinsley et Katie Jones (2), des profils fabriqués de toute pièce pour espionner certaines cibles sur Linkedin, personne n’a pu mettre la main sur la ou les personnes qui se cachent derrière l’avatar. La photo de profil ressemble en tous points à ce qu’il est possible de créer sur le site Thispersondoesnotexist.com (3). L’exercice est si simple que la série ci-dessous a été réalisée en quelques minutes, en croisant les images produites par le site avec l’application Faceapp (4) permettant le vieillir les visages.

Agrandissement : Illustration 2

Taylor n’est que la façade d’une opération de déstabilisation visant un couple d'universitaires Londoniens (5), tout comme Kinsley et Jones servaient d’interface à des opérations de rapprochement avec des diplomates et des chefs d’entreprises influents. La création de ces profils, parfois peu élaborés, parfois plus sophistiqués, a été sans aucun doute réalisée en quelques dizaine de minutes avec des outils accessibles par tous sur internet.

Les salariés sont des deepfakes

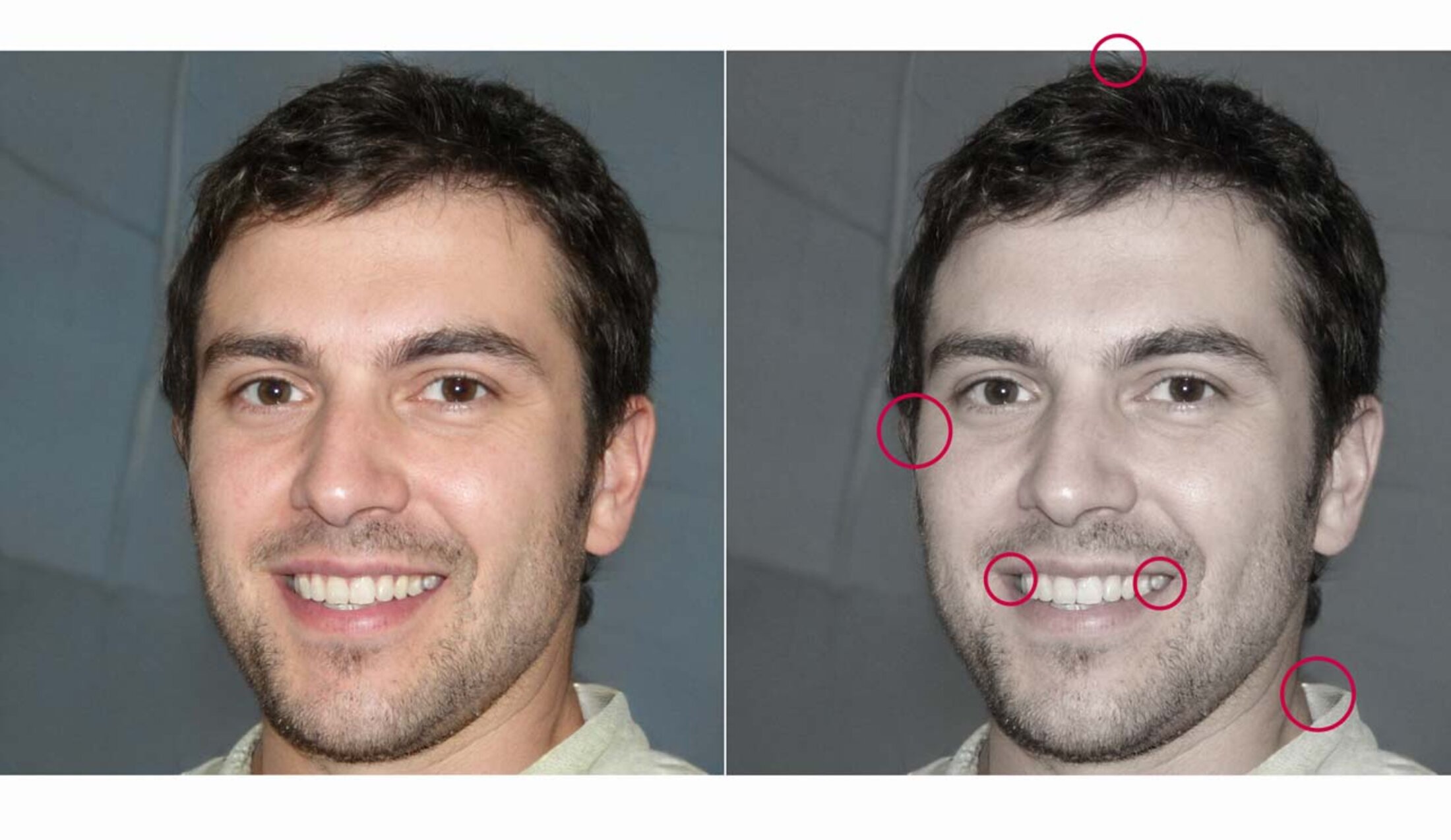

Dernière découverte en date, une entreprise entière dont les profils ont été générés artificiellement puis manipulés sur un service bon marché de retouche d'images. C’est Giorgio Patrini, le CEO de Deeptrace, une société spécialisée dans la détection de deepfakes, basée à Amsterdam, qui lève le lièvre.

Agrandissement : Illustration 3

Après vérification de journalism.design, les images de profil présentent toutes des artefacts grossiers, cohérents avec l’usage d’un générateur de type Thispersondoesnotexist. Toute l’opération semble d’ailleurs particulièrement opaque et franchement louche. Pas besoin de faire de longues recherches avant de se retrouver dans une impasse (littéralement) en tapant l’adresse supposée de la société. Celle-ci, basée à Manchester, n’est qu’une boite aux lettres, un prête-nom pour sociétés désireuses de passer sous le radar.

Ces fraudes ou ces opérations louches ont de grandes chances de se multiplier à l’avenir, les outils étant abordables, libres d’accès et leur usage anonyme. L’exposition médiatique faible, l’éducation aux médias synthétiques ridicule, contribue au développement de ces pratiques.

❋

Cet article a été publié pour la première fois sur deepfake.media

Références

1. « Deepfake used to attack activist couple shows new disinformation frontier » par Raphael Satter, Reuters, le 15 Juillet 2020

2. « Cybersécurité et deepfakes, une menace sérieuse » par Jounalism.design, le 21 mars 2020

3. Le site thispersondoesnotexist.com est un générateur de visage qui repose sur un algorithme appelé StyleGAN2

4. « FaceApp Lets You ‘Age’ a Photo by Decades. Does It Also Violate Your Privacy?” New York Times, le 17 juillet 2019

5. « This journalist isn’t real. His destructive stories are.” par Matthew Wille, Input